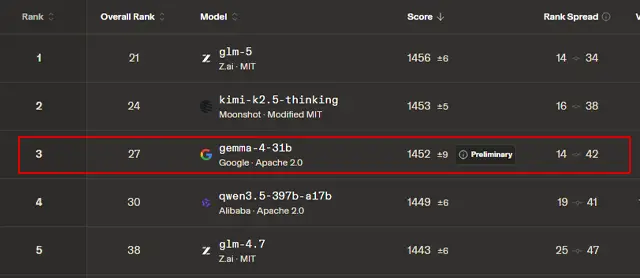

Gemma 4 : la nouvelle IA de Google va transformer vos appareils et vos applications

Aujourd'hui, nous vivons un paradoxe technologique frustrant : la puissance phénoménale des LLM reste largement inféodée au cloud. Pour obtenir une réponse, vos données transitent par des serveurs distants, soulevant des enjeux critiques de confidentialité, de latence et de souveraineté.

Imaginez que la véritable intelligence n’ait plus besoin de "téléphoner à la maison". Avec Gemma 4, Google brise ces chaînes. Nous sommes à l'aube d'une IA 100 % locale et privée, capable de tourner nativement sur smartphone, laptop ou Raspberry Pi.

Voici les 5 évolutions majeures pour la conception de nos systèmes :

1. La liberté totale avec la licence Apache 2.0

Le changement le plus stratégique de Gemma 4 est juridique. Google rompt avec ses habitudes et distribue cette version sous licence Apache 2.0.

C'est une révolution pour l'écosystème : une liberté commerciale totale, sans limite d'utilisateurs actifs mensuels (MAU) ni audits intrusifs. Les entreprises peuvent déployer ces modèles avec une souveraineté numérique absolue sur leur propre infrastructure.

"La publication de Gemma 4 sous licence Apache 2.0 est un jalon majeur. Nous sommes incroyablement enthousiastes à l'idée de soutenir la famille Gemma 4 sur Hugging Face dès le premier jour." — Clément Delangue, PDG de Hugging Face.

2. Architecture "Effective" (PLE) : La puissance sans le poids

Faire tenir un modèle massif dans la mémoire d'un appareil mobile demande une optimisation radicale. La solution : les Per-Layer Embeddings (PLE). Contrairement aux architectures classiques, le PLE ne rajoute pas de couches de calcul actives, mais dote chaque couche du décodeur de son propre petit embedding.

Les variantes E2B et E4B offrent ainsi la profondeur de représentation de modèles bien plus lourds avec un coût de calcul faible. Le modèle E2B peut même descendre sous 1,5 Go de RAM.

| Modèle Gemma 4 | BF16 (16-bit) | SFP8 (8-bit) | Q4_0 (4-bit) | RAM recommandée (min) |

|---|---|---|---|---|

| E2B (2.3B act.) | 9,6 Go | 4,6 Go | 3,2 Go | 4 - 5 Go |

| E4B (4.5B act.) | 15 Go | 7,5 Go | 5 Go | 5,5 - 6 Go |

| 26B-A4B (MoE) | 48 Go | 25 Go | 15,6 Go | 16 - 18 Go |

| 31B (Dense) | 58,3 Go | 30,4 Go | 17,4 Go | 17 - 20 Go |

Note stratégique : Le modèle 26B-A4B (Mixture-of-Experts) n'active que 3,8 milliards de paramètres par passage pour garantir la vitesse, mais exige le chargement complet de ses 26 milliards de paramètres en VRAM.

3. Le mode "Réflexion" et les capacités agentiques

Gemma 4 ne se contente plus de prédire le mot suivant, il "pense" de manière structurée. L'insertion du jeton <|think|> dans le prompt système active le Thinking Mode. Le modèle expose alors son raisonnement interne avant de formuler sa réponse.

Couplée à une fenêtre de contexte de 256 000 jetons, cette architecture transforme Gemma 4 en un véritable agent capable de planification multi-étapes et de décodage contraint (JSON structuré). On peut lui confier des tâches de modération strictes en local :

Détermine si ce commentaire respecte les règles.

Échec si profanité. Succès = {true}, sinon {false, raison}.

4. Multimodalité native : de l'audio à la vidéo

Gemma 4 gère nativement le multimodal, avec une distinction claire selon les modèles :

- Audio natif : Exclusif aux E2B et E4B (reconnaissance et traduction vocale jusqu'à 30s).

- Vidéo native : Réservé aux 26B et 31B (analyse de séquences jusqu'à 60s).

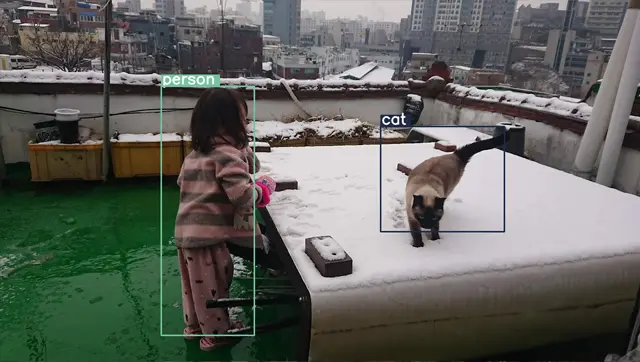

Tous les modèles gèrent les images avec des budgets de tokens variables (70 à 1120). Le spectre d'utilisation s'étend de la simple classification rapide à l'OCR de haute précision, en passant par la détection spatiale d'objets (capacité à identifier et isoler des éléments précis via la génération de boîtes englobantes).

"Faire fonctionner des modèles de compréhension visuelle comme Gemma 4 sur l'appareil ouvre la porte à des descriptions de scènes fiables pour les utilisateurs malvoyants. L'accès hors ligne est crucial." — Karthik Mahadevan, PDG d'Envision.

5. L'optimisation extrême pour le matériel Arm et Android

Le secret de cette fluidité réside dans une intégration logicielle profonde. En exploitant l'architecture Armv9 et les instructions SME2 via KleidiAI et XNNPACK, Google annonce un gain de performance de 5,5x en pré-remplissage.

Les résultats sur un simple Raspberry Pi 5 sont éloquents : le modèle E2B atteint 133 tokens/s en pré-remplissage. Le décodage se maintient à 7,6 tokens/s pour une interaction fluide, tout en consommant 60 % de batterie en moins.

Focus Projet : Améliorer "Wano Collector" avec l'IA locale

Pour notre projet Wano Collector, Gemma 4 E2B et Gemma 4 E4B sont très prometteur. Fini les allers-retours coûteux vers le cloud pour identifier une pièce rare, extraire les données d'un certificat d'authenticité ou simplement lister les produits sur une étagère.

En exploitant la capacité d'analyse visuelle maximale du modèle (1120 tokens, ce qui correspond à un découpage très fin de l'image pour en capter les moindres détails en haute définition), l'application pourra réaliser un OCR ultra-précis et analyser l'état physique de l'objet via la caméra. Grâce au raisonnement agentique, l'IA classera automatiquement l'objet selon des critères logiques complexes, 100 % hors ligne. L'assistant expert littéralement dans la poche.

Conclusion : Vers une IA omniprésente et hors ligne

Gemma 4 marque un tournant définitif : l'IA "frontière" n'est plus l'apanage des data centers. En combinant une licence permissive, l'architecture PLE et des capacités de raisonnement, Google offre les clés d'une IA véritablement personnelle, sécurisée et taillée pour les systèmes autonomes. L'IA n'est plus une destination lointaine, c'est une fonction native de vos appareils.

Si vous souhaitez concevoir une application mobile, une architecture IA on-device ou réduire vos coûts d’inférence, n’hésitez pas à nous contacter et parlons-en ensemble. 😊